OpenAI ha dado un paso significativo en la evolución de sus servicios al anunciar una serie de nuevas herramientas y una API mejorada orientadas a facilitar la creación de agentes de inteligencia artificial. Estas novedades, presentadas en marzo de 2025, incluyen la integración nativa de búsqueda web, búsqueda de archivos y uso del ordenador dentro de la API, el lanzamiento de una nueva “Responses API” más potente, y un Agents SDK de código abierto para orquestar agentes.

La noticia ha generado gran expectación en la comunidad tecnológica por su impacto en desarrolladores y empresas, especialmente en España, donde la adopción de IA generativa se encuentra en pleno auge. (El confidencial) (La ecuación digital)

Búsqueda web integrada: respuestas actualizadas con fuentes

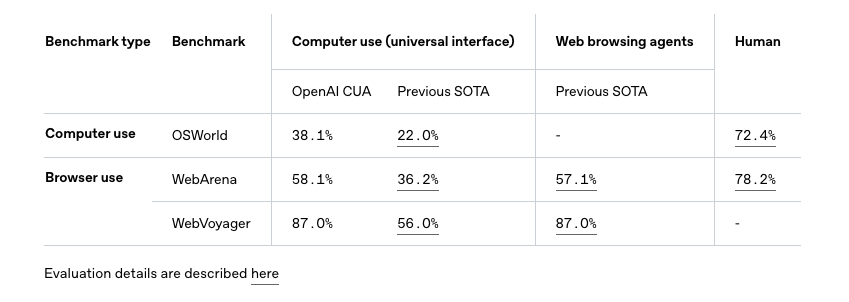

Una de las incorporaciones estrella es la herramienta de búsqueda web integrada en la API de OpenAI. Esta funcionalidad permite que los modelos de lenguaje obtengan información en tiempo real de Internet, incluyendo citas con fuentes relevantes, directamente como parte de sus respuestas. En la práctica, esto significa que un desarrollador puede habilitar que su agente consulte la web y ofrezca resultados actualizados con referencias, similar a cómo lo hace ChatGPT con su modo de búsqueda.

Las pruebas iniciales muestran un alto nivel de precisión: en el benchmark SimpleQA para preguntas factuales cortas, GPT-4o con búsqueda obtuvo un 90% de exactitud, comparado con un 88% de su versión mini. Las respuestas generadas incluyen enlaces a artículos de noticias y blogs, lo que da al usuario final confianza y posibilidad de profundizar en la información. Además, los propietarios de sitios web pueden optar por aparecer en estos resultados, asegurando transparencia y trazabilidad de la información.

OpenAI ha confirmado que la búsqueda web en la API es de acceso abierto para desarrolladores en fase previa (preview), con un modelo de precios por volumen de consultas similar al de ChatGPT con navegación. (OpenAI).

Esto coloca a OpenAI en competencia directa con servicios especializados de búsqueda con IA: por ejemplo, herramientas como Perplexity AI ya ofrecían respuestas con referencias, convirtiéndose en “una herramienta ideal para investigación y verificación de datos” según análisis recientes. (Softzone)

Búsqueda de archivos: aprovechando datos internos con IA

Junto a la búsqueda web, OpenAI ha potenciado su herramienta de búsqueda de archivos (file search tool), pensada para recuperación de información en grandes volúmenes de documentos. En otras palabras, facilita que un agente encuentre rápidamente la respuesta en una base documental extensa, ya sea una biblioteca de PDFs, una base de conocimiento corporativa o historiales de casos.

Uso del ordenador: hacia la automatización de tareas complejas

Quizá la herramienta más sorprendente presentada es “Computer Use” (uso del ordenador), que permite a un modelo realizar acciones en un entorno informático simulado tal como lo haría un usuario: moviendo el ratón, pulsando teclas, navegando por aplicaciones, etc. Esta capacidad abre la puerta a agentes capaces de completar tareas en un ordenador de forma autónoma, como por ejemplo interactuar con una interfaz web, rellenar formularios o manejar software legacy que no tiene APIs disponibles.

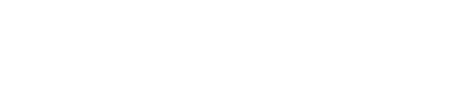

La herramienta está respaldada por el modelo denominado CUA (Computer-Using Agent) de OpenAI, el mismo que da vida a su producto interno “Operator". Se trata de un modelo en fase de research preview que ya ha logrado resultados punteros en benchmarks académicos de agentes con acceso a entornos completos. Por ejemplo, alcanzó un 38,1% de éxito en OSWorld (una evaluación de tareas de sistema operativo), superando con creces al récord anterior de 22%. En entornos de navegación web como WebArena y WebVoyager, consiguió 58,1% y 87% de éxito respectivamente. Aunque a primera vista porcentajes del 38% puedan parecer bajos, hay que entender la dificultad: implica que el agente logró completar más de un tercio de tareas de sistema operativo sin intervención humana, algo nunca visto hasta ahora y que confirma tanto el potencial como las limitaciones actuales

Técnicamente, al activar la herramienta de uso del ordenador en la API, el desarrollador puede especificar parámetros como la resolución de pantalla simulada o si el entorno es un navegador web, etc. El modelo genera una secuencia de acciones (clics, tipeos) que la herramienta captura y ejecuta en un entorno aislado.

Con gran poder vienen grandes responsabilidades, y OpenAI lo ha reconocido implementando importantes medidas de seguridad antes de liberar esta función. Durante el desarrollo de CUA y su uso en Operator, se hicieron red teamings extensivos enfocados en malos usos, errores del modelo y riesgos frontera. Para la versión API, añadieron checks de seguridad contra prompt injections (intentos de que el usuario engañe al agente para que haga algo indebido), confirmaciones para tareas sensibles y herramientas para que los desarrolladores aíslen sus entornos. Pese a ello, OpenAI advierte que el modelo aún puede cometer errores inadvertidos, especialmente fuera del navegador, y da un ejemplo claro: con un 38% de éxito en OSWorld, está lejos de ser infalible, por lo que recomiendan supervisión humana cuando se use en sistemas operativos reales.

Inicialmente, el acceso a la herramienta de uso del ordenador está algo más restringido: se lanza como preview para ciertos desarrolladores de niveles de uso 3 a 5 en la plataforma. El modelo de precios también difiere: en lugar de por consulta, se cobra por tokens consumidos, dado que estas interacciones pueden ser largas; la tarifa anunciada es de $3 por millón de tokens de entrada y $12 por millón de tokens de salida.

Responses API: una nueva forma de interactuar con modelos y herramientas

En el centro de este lanzamiento está la nueva API de Respuestas (Responses API), que OpenAI define como su “nuevo primitivo de API” para aprovechar las herramientas integradas y construir agentes.

Para los desarrolladores, esto se traduce en poder realizar tareas mucho más complejas en una sola llamada de API, encadenando múltiples interacciones del modelo y uso de varias herramientas de forma fluida es decir, el modelo ya no solo conversa, sino que puede razonar en varios pasos y consultar herramientas de manera intercalada, todo gestionado por OpenAI en segundo plano.

Una de las mejoras clave de la Responses API es que simplifica la gestión del estado conversacional y la orquestación, aspectos que con la API antigua requerían mucho trabajo manual. Hasta ahora, con la API de chat estándar, los desarrolladores debían mantener el historial completo de la conversación y enviarlo en cada petición, lo cual se volvía engorroso (y caro en tokens) a medida que la conversación crecía (Simon Willison)

Agents SDK: orquestando agentes y flujos de trabajo

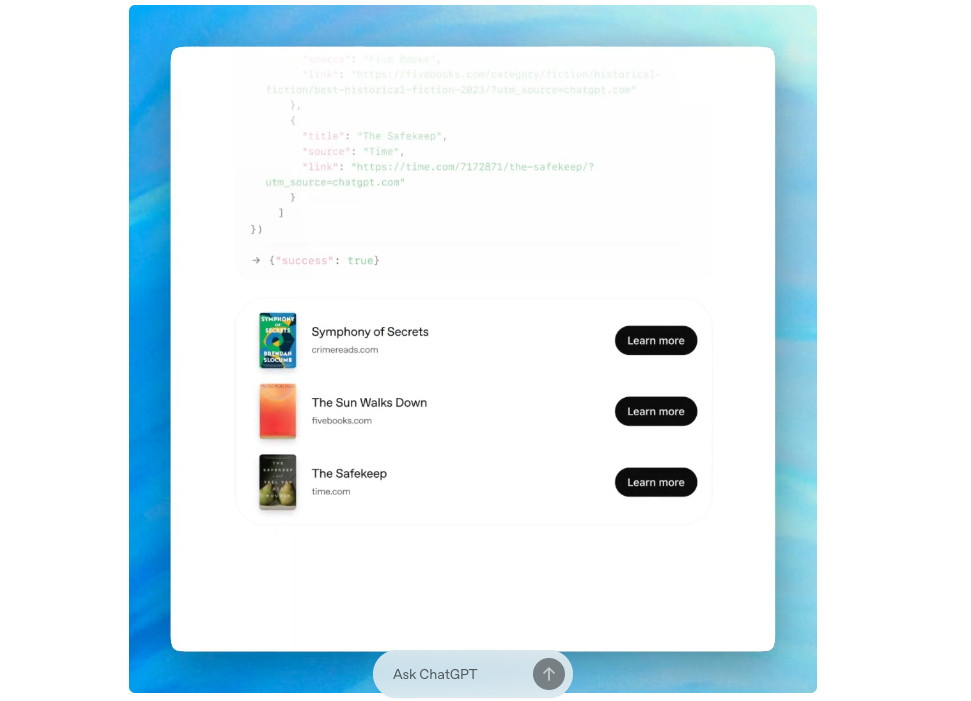

Otra pieza fundamental del anuncio es el Agents SDK, un nuevo kit de desarrollo de código abierto pensado para orquestar flujos de trabajo con uno o múltiples agentes. Si la Responses API se encarga de la lógica interna de un agente (modelo + herramientas), el Agents SDK aborda la capa superior: cómo conectar agentes entre sí, aplicar reglas de negocio, implementar guardas de seguridad y visualizar lo que ocurre en el proceso.

OpenAI ya había experimentado en 2024 con una librería llamada Swarm, que permitía coordinar varios agentes. Este Agents SDK toma el aprendizaje de Swarm y lo lleva al siguiente nivel, incorporando mejoras notables

- Definición sencilla de agentes: se pueden configurar instancias de LLM con instrucciones específicas y con herramientas adjuntas de forma muy directa. En el SDK, un Agent es básicamente un rol con un propósito (por ejemplo, un agente de soporte, un agente de compras) al que le asignamos qué puede hacer.

- Handoffs inteligentes: los agentes pueden transferirse el control entre sí según la naturaleza de la tarea. Por ejemplo, un agente “triage” puede recibir la consulta de un usuario y decidir si la debe resolver él o pasarla a un agente especialista (como ventas o soporte). Este concepto de handoff inteligente permite componer agentes especializados sin que el usuario note la transición.

- Guardrails (barreras de seguridad): el SDK facilita implementar validaciones de entrada y salida para los agentes. Esto es crucial en entornos productivos: por ejemplo, verificar que la respuesta de un agente no contenga información confidencial antes de entregársela a un cliente, o asegurar que la consulta de un usuario no viola políticas antes de procesarla.

- Tracing y observabilidad: se proveen herramientas para visualizar las trazas de ejecución de los agentes, facilitando la depuración y optimización. Poder ver paso a paso qué decidió cada agente, qué resultados obtuvo de cada herramienta, etc., ayuda a los desarrolladores a comprender el comportamiento de sistemas complejos y ajustar los prompts o configuraciones para mejorar resultados.

Enlace al vídeo de presentación

OpenAI destaca que este SDK es útil para automatización de atención al cliente, flujos de investigación en varias etapas, generación de contenidos complejos, revisión de código asistida, prospección de ventas, y más. Ya hay empresas probándolo: Coinbase, por ejemplo, utilizó Agents SDK para prototipar en horas un sistema llamado AgentKit, donde agentes de IA interactúan con wallets de criptomonedas y ejecutan acciones en la cadena de bloques. Integraron funciones personalizadas de su propio SDK de cripto dentro de estos agentes, logrando en poco tiempo un agente plenamente funcional que simplificó radicalmente cómo agregar nuevas acciones.

Otro caso es Box, la empresa de gestión de contenido en la nube, que en solo un par de días construyó con Agents SDK agentes capaces de combinar búsqueda web y consultas en sus propios repositorios de archivos corporativos.

Es importante mencionar que el Agents SDK no está limitado a los modelos de OpenAI. Según la documentación, funcionará también con modelos de otros proveedores siempre que ofrezcan un endpoint estilo Chat Completions.

Con la llegada de Agents SDK, la creación de agentes inteligentes pasa a un nivel de abstracción más alto. Ya no se trata solo de “qué puede hacer un modelo”, sino de coordinar equipo de agentes con diferentes roles y asegurar que trabajen de forma confiable.

Casos de éxito en España: adopción temprana de agentes y IA generativa

Uno de los hitos más destacados fue el acuerdo de IE University con OpenAI para integrar herramientas de IA a gran escala en su ecosistema educativo (El Confidencial)

Anunciado a inicios de 2025, IE University se convirtió en la primera universidad en España en ofrecer a todos sus alumnos, profesores y personal acceso a ChatGPT Edu, una versión avanzada del modelo adaptada a entornos académicos. Según explican desde la institución, el objetivo es potenciar la productividad y el aprendizaje personalizado sin caer en un uso negligente; los alumnos seguirán creando y razonando, pero ahora apoyados por la IA para maximizar su proceso formativo (Enrique Dans).

Este caso demuestra una adopción reflexiva: no es implantar ChatGPT sin más, sino rediseñar la experiencia educativa en torno a la IA. La propia Leah Belsky, directora general de Educación en OpenAI, afirmó que “la IA es una herramienta poderosa que mejora el aprendizaje... El acceso a ChatGPT Edu promueve aprendizaje personalizado y mayor eficiencia”, posicionando a IE University a la vanguardia educativa.

En el sector financiero, BBVA se ha erigido como pionero en Europa al firmar una alianza con OpenAI para desplegar ChatGPT Enterprise entre sus empleados (BBVA) (Fintechfutures)

El banco español, con 125.000 empleados globalmente, adoptó en 2023 la versión empresarial de ChatGPT otorgando acceso masivo a todas las áreas y fomentando la experimentación interna. En tan solo 5 meses lograron crear más de 2.900 “GPTs” personalizados desarrolladas por empleados de departamentos tan diversos como legal, riesgos, marketing o recursos humanos.

La filosofía de BBVA, en palabras de Elena Alfaro, responsable global de adopción de IA, es que “la inversión en ChatGPT es una inversión en nuestra gente. La IA amplifica nuestro potencial y nos ayuda a ser más eficientes y creativos” (openAI)

El caso BBVA muestra un ejemplo concreto de impacto empresarial: la democratización de la IA dentro de una gran empresa, con resultados medibles en productividad e innovación.

En el ámbito público, destaca la apuesta del Gobierno de España por impulsar la adopción de la IA en el tejido empresarial. A finales de mayo de 2024, el Consejo de Ministros aprobó la nueva Estrategia Nacional de Inteligencia Artificial, con un presupuesto de 1.500 millones de euros para 2024-2025, de los cuales 650 millones se destinan específicamente a programas de adopción de IA en pymes. Esta inversión, canalizada en parte a través del programa Kit Digital y del fondo Next Tech, busca que las pequeñas y medianas empresas incorporen herramientas como ChatGPT en sus procesos. (La ecuación digital). Según encuestas citadas en La Ecuación Digital, dos de cada tres pymes españolas (65%) ya consideran las herramientas de IA generativa tipo ChatGPT como tecnologías necesarias para modernizarse y ser competitivas

Planes a futuro: hacia una plataforma unificada de agentes

OpenAI enfatizó que cree que los agentes pronto serán parte integral de la fuerza laboral, potenciando la productividad en todos los sectores.

Con agentes tomando decisiones más autónomas, será crucial tener herramientas para monitorizar su performance en producción. OpenAI ya integró trace viewing y planea mejorar capacidades de evaluaciones automáticas del desempeño de agentes en distintos escenarios. OpenAI insinuó que conforme los modelos se vuelvan más “agentivos”, invertirán en integraciones más profundas entre sus APIs y nuevas herramientas.

OpenAI ha marcado con este lanzamiento un camino claro hacia agentes de IA cada vez más capaces y fáciles de implementar. Para desarrolladores y empresas en España, subirse a esta ola supone acceder temprano a ventajas competitivas en eficiencia e innovación. Como hemos visto, ya hay actores españoles que lo han hecho y líderes de la industria que apoyan el movimiento. Con la rápida evolución de la IA, es probable que en el corto plazo veamos casos que hoy suenan futuristas volverse realidad cotidiana: asistentes jurídicos preparando contratos, agentes financieros tomando decisiones de inversión acotadas, tutores virtuales personalizados para cada estudiante, y un largo etcétera